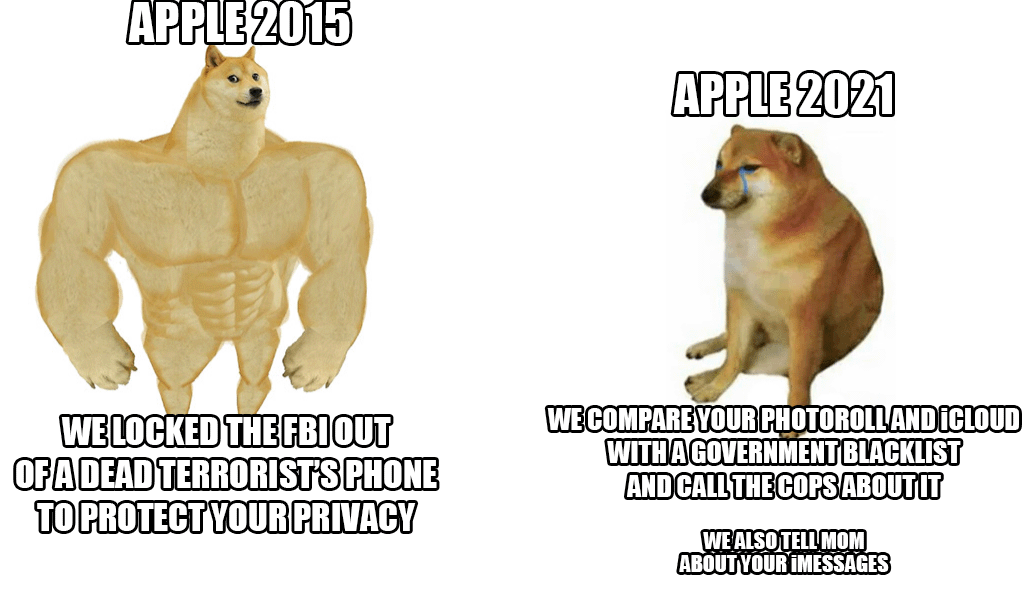

A múlt hét végén az Apple bemutatott egy új, gyermekbántalmazás elleni rendszert, amely gyakorlatilag mindenki iCloud-fotóját fogja átvizsgálni. Bár az ötlet első ránézésre jól hangzik, hiszen a gyerekeket valóban meg kell védeni ettől az akciótól, a cupertinói óriáscéget ennek ellenére lavina bírálta – nemcsak a felhasználók és a biztonsági szakértők részéről, hanem maguk az alkalmazottak soraiból is.

Egy elismert ügynökség legfrissebb információi szerint Reuters számos alkalmazott fejezte ki aggodalmát ezzel a rendszerrel kapcsolatban a Slackkal kapcsolatos belső kommunikációban. Állítólag félniük kell a hatóságok és kormányok esetleges visszaéléseitől, akik visszaélhetnek ezekkel a lehetőségekkel, például emberek vagy kiválasztott csoportok cenzúrázására. A rendszer feltárása heves vitát váltott ki, amely már több mint 800 egyéni üzenetet tartalmaz a fent említett Slacken belül. Röviden: az alkalmazottak aggódnak. Korábban már biztonsági szakértők is felhívták a figyelmet arra, hogy illetéktelen kezekben valóban veszélyes fegyver lenne, amivel aktivisták, az általuk emlegetett cenzúra és hasonlók elnyomják.

A jó hír (egyelőre), hogy az újdonság csak az Egyesült Államokban indul. Egyelőre még az sem világos, hogy az Európai Unió tagállamaiban is alkalmazni fogják-e a rendszert. Az Apple azonban minden kritika ellenére kiáll és megvédi a rendszert. Mindenekelőtt azzal érvel, hogy minden ellenőrzés a készüléken belül történik, és ha egyszer van egyezés, akkor csak abban a pillanatban ellenőrzi újra az esetet az Apple munkatársa. Csak saját belátása szerint adják át az illetékes hatóságoknak.

Lehet, hogy érdekel téged

Nem szívesen váltanám az iCloudról valami biztonságos és igazán privát szolgáltatásra, de ha az Apple ragaszkodik hozzá, akkor sem fizetek nekik.

Csak az Egyesült Államokban lesz aktív (egyelőre).

Teljesen mindegy, hogy a törvényileg hol alkalmazzák. Ez a technológia már kint lesz és telepítve lesz. Ez a legnagyobb kockázat.